業務のデジタル化や自動化は、今の産業界のホットなトピック。そんなオートメーション化の波はSNSにも押し寄せたのか、現在ではBotnetというアプリまで生まれるほどになりました。

このBotnet、一見はツイッターのようなSNSの形式で、投稿すれば大勢からレスポンスが返ってきます。しかしその反応はどれもアプリからの自動返信。いいねの数を増やすのも、返信の文面を作るのも、全てが自動化されたアクションなのです。

もちろんこれはジョークアプリですが、似た出来事は他のSNS上でも起きています。現在、自動アカウントなどを活用したSNS世論操作が世界的に大きな問題になっているのです。本記事では、オックスフォード大学とニューヨーク大学が行った調査をもとに、その現状や今後の課題を見ていきます。

コロナウイルス関連の偽情報拡散

2016年のアメリカ大統領選挙以来、フェイクニュースや偽情報はSNSを含めた各種メディアでかつてない注目を集めています。

近年では特に、SNS上での組織的な情報工作が行われている証拠が見つかっています。

その最たるものが、2020年に起こったCOVID-19のパンデミック。この時は、発生当初からさまざまな偽情報が蔓延していました。

それについて、カーネギーメロン大学が興味深い研究を行っています。それによると、COVID-19について発言するツイッターアカウントの45~60%がボット、つまり自動アカウントであった可能性が指摘されています。

もちろん、ボット自体はこれまでも一定数存在していました。問題はその割合です。選挙に関連するイベントについては、従来なら10~20%がボットだと推定されてきました。およそ半数近くというCOVID-19の事例は、ボットの活用が大規模化していることを反映していると考えられます。

2020年6月のフェイクアカウント大量BAN

それを裏付けるように、中国政府が背後にいるとみられるフェイクアカウントの大量BANが発覚しています。

舞台となったのはツイッター。中国のプロパガンダに関与していたとされるおよそ24000のアカウントと、メッセージの拡散に使われたとみられる15万アカウントの一斉BANが報じられました。

これらのアカウントはCOVID-19に関連する偽情報拡散への関与も疑われています。

オックスフォード大学の調査

こうした事例は、SNSを使った世論操作のごく一部の事例。そのすべてを知るのは困難ですが、オックスフォード大学が2019年に公開した報告書からは、おおまかな全体像が見えてきます。

その調査結果からは、わずか数年で情勢が大きく変化していることが読み取れます。

関与する国とその変化

先述のカーネギーメロン大学の調査からも察せる通り、SNS上での世論操作は拡大を続けています。調査の始まった2017年には、関与が確認された国は28カ国でした。それが2018年には48カ国となり、2019年には70カ国にまで増えています。

大部分は自国内だけで工作を行っていますが、このうち7カ国は国外でも動いていることがわかっています。

こうした工作の実行国のうち、最大手とされるのは中国。

香港での民主化デモは注目すべき事例でしょう。このときは、WeiboやWeChat上で政府主導の工作が行われていたことがわかっています。

現在中国ではツイッターやフェイスブックが規制されているため、工作はもっぱら中国製アプリ上で行われてきました。しかしやがては中国国外の主要プラットフォーム上にも展開してくることが予想されています。

使われるツール

フェイクアカウント

SNS世論操作の基本ツールは、工作用のフェイクアカウント。

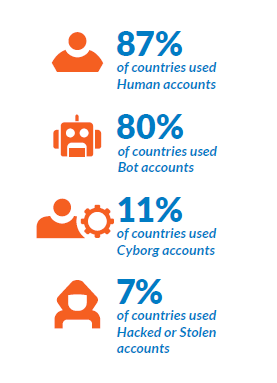

フェイクアカウントには完全な自動ボット、人間が操作するアカウントなどがあります。

自動ボットはもっぱら、あらかじめ設定された文章の投稿、既存の投稿のシェアなどを自動で行います。多数の自動アカウントを用意すれば、膨大な量の発信で反対意見を押し流したり、自分たちの発信を広く拡散したりするのに活用できます。

フェイクアカウントを人間が操作している例もあります。これは技術力を要しない手法だからか、60~70カ国と多くの国で採用されている手法。

ベトナムやタジキスタンではこのほか、自分自身のアカウントを使ってのプロパガンダ発信やコンテンツの違反報告などを行うよう呼びかけているとか。

また最近の傾向として、ハックアカウントの利用も増えています。

ハックのターゲットとなるのは主に著名人など、影響力・拡散力が高く、発信内容も信頼されやすいアカウント。

活用している国はまだ少数ですが、昔からあるアカウントハックが今後はデジタルプロパガンダの一翼を担うと予想されています。

出典:https://comprop.oii.ox.ac.uk/wp-content/uploads/sites/93/2019/09/CyberTroop-Report19.pdf

発信戦略

報告書の中では、このような偽アカウントが何を目的にどう使われるのか、という点にも踏み込んでいます。

自分に都合の良い情報の発信

フェイクアカウントを活用する一番の目的は、偽情報の拡散やミスリードの誘発です。

調査対象となった70カ国のうち、実に52カ国で何らかの偽情報発信が行われています。

発信内容は主にネットミームや動画、フェイクニュースなど。ブログやSNS上で公開された偽情報はボットアカウントが自動で拡散し、多くの人の目に触れることになります。

反対意見の封殺

偽情報の発信と並んで広く使われるのは、反対意見の封殺です。そのターゲットになるのは自分たちに不利な報道をしようとするジャーナリストや反体制派の人間。

その手法にもいくつかあります。

ひとつはコンテンツへの集団通報。各SNSプラットフォームには規約に反しているコンテンツを運営に報告し、コンテンツ削除を求める機能が備わっています。

多数のアカウントを動員して一斉にコンテンツやユーザーを通報すれば、反対意見をプラットフォーム上から取り除くことができます。

また、ユーザー本人をターゲットにした荒らしやハラスメントも封殺手段のうち。ハラスメントに嫌気がさしてプラットフォーム上からユーザーがいなくなれば、その影響力も損なわれてしまいます。

2018年には27カ国が採用していたこの手口、2019年には47カ国が採用しているという調査結果が出ていることを見ると、急速に普及しているといえるでしょう。

ターゲットは何も影響力のある人に限りません。

一般の人をターゲットに幅広くハラスメントを行うことでも、何らかのトピックに関する会話に参加する人を減らすことにつながるため、結果的に意見の封殺をしやすくなるになるのです。